Способность различать реальные и искусственные изображения становится всё более важной. Развитие генерации изображений ИИ происходит стремительно, что затрудняет выявление подделок невооружённым глазом. Однако существует несколько инструментов и методов, которые помогают проверить подлинность в эпоху, когда дезинформация распространена повсеместно. В этой статье описывается, как надёжно идентифицировать визуальные материалы, созданные ИИ, с акцентом на практические методы, доступные каждому.

Использование Водяных Знаков и Инструментов Происхождения

Многие ИИ-платформы теперь встраивают скрытые водяные знаки в свои результаты. Google Gemini, например, использует SynthID, который можно обнаружить, загрузив изображение в Gemini и спросив: «Было ли это изображение создано ИИ?». Этот метод не является безошибочным, поскольку водяные знаки можно удалить с помощью простого скриншота, но это быстрый первый шаг.

Другим стандартом является Коалиция по Происхождению и Подлинности Контента (C2PA). Поддерживаемая крупными компаниями, такими как OpenAI, Adobe и Google, C2PA маркирует изображения метаданными, указывающими на их происхождение. Сайты, такие как Content Credentials, могут анализировать изображения на наличие C2PA-тегов, часто раскрывая, какая ИИ-модель их создала. Эти проверки не являются окончательным доказательством, но позволяют обнаружить значительное количество изображений, сгенерированных ИИ.

Контекстуальная Проверка: Откуда Появилось Изображение?

Происхождение и окружающий контекст изображения имеют решающее значение. Надёжные издания чётко маркируют контент, сгенерированный ИИ, обеспечивая прозрачность. Напротив, социальные сети являются рассадником непроверенных изображений, часто предназначенных для манипулирования вовлечением через противоречия или эмоциональную привлекательность.

При изучении изображения, связанного с новостной статьёй, ищите подтверждающие визуальные материалы с разных ракурсов. Согласуются ли детали между различными перспективами? Для иллюстраций проверьте наличие указания автора, ведущего к его портфолио. Обратный поиск изображений с помощью таких инструментов, как TinEye, может выявить, было ли изображение ранее опубликовано где-либо ещё, что может указывать на генерацию ИИ, если совпадений нет, особенно на недостоверных платформах.

Выявление Артефактов ИИ: Общие Черты и Несоответствия

ИИ-модели генерируют изображения на основе данных обучения, что приводит к определённым признакам. Общие элементы распространены : персонажи аниме, сгенерированные ИИ, напоминают устоявшиеся тропы аниме, деревья выглядят однородно, а городские пейзажи выглядят искусственно. Даже текст, сгенерированный внутри изображений ИИ, часто по умолчанию использует узнаваемый «средний» шрифт.

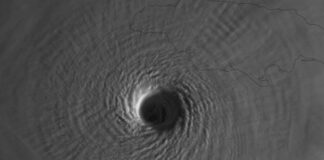

Физические неточности остаются предательскими признаками. ИИ плохо справляется со сложными средами: замки могут иметь бессмысленные башни, лестницы никуда не ведут, а внутренние пространства содержат нелогичные конструкции. Лица и конечности часто выглядят искажёнными, с размытыми или неестественными деталями. Хотя руки с шестью пальцами встречаются всё реже, тонкие несовершенства сохраняются при практике.

Растущая сложность генерации изображений ИИ делает проверку необходимой. Сочетая проверку водяных знаков, контекстуальный анализ и внимание к деталям, пользователи могут значительно улучшить свою способность различать реальные и синтетические изображения.

В заключение, хотя изображения, сгенерированные ИИ, становятся всё более убедительными, их выявление возможно благодаря сочетанию технических инструментов и критического мышления. Ключ в том, чтобы оставаться бдительными и использовать доступные ресурсы для проверки подлинности в всё более обманчивом цифровом ландшафте.