Terwijl humanoïde robots overgaan van sciencefiction naar toepassingen in de echte wereld – werkend aan de assemblagelijnen van BMW, ziekenhuizen binnendringend en op weg naar massaproductie door bedrijven als Tesla – rijst er een kritische ethische vraag: Zijn we onbedoeld geprogrammeerd om race aan machines toe te wijzen?

Recent onderzoek suggereert dat naarmate robots steeds menselijker worden, ze niet immuun zijn voor dezelfde sociale hiërarchieën en vooroordelen die de menselijke samenleving bepalen. Nog verontrustender is dat veel mensen deze vooroordelen niet lijken te herkennen wanneer ze ze maken.

De verborgen keuzepatronen

Een studie gepubliceerd in maart 2026 door onderzoekers Jiangen He, Wanqi Zhang en Jessica K. Barfield onthult een opvallende kloof tussen de manier waarop mensen robots kiezen en hoe ze die keuzes rechtvaardigen.

Toen ze verschillende werkplekscenario’s voorgeschoteld kregen (zoals een ziekenhuis, een bouwplaats of een school) en gevraagd werd een robot te kiezen uit een reeks verschillende huidtinten, weerspiegelden de keuzes van de deelnemers al lang bestaande menselijke stereotypen:

– Handmatige arbeidsrollen werden vaak toegewezen aan robots met een donkere huidskleur.

– Professionele en academische rollen werden vaak toegewezen aan robots met lichtere huidtinten.

– Atletische rollen vertoonden een voorkeur voor huidtinten die verband houden met de zwarte identiteit.

De verdediging van “praktischheid”.

Wat deze bevinding bijzonder complex maakt, is de taal van de rechtvaardiging. Op de vraag waarom ze een specifieke kleur kozen, noemden de deelnemers zelden ras. In plaats daarvan gebruikten ze ‘neutrale’ of functionele redeneringen:

* Ze voerden aan dat witte robots er ‘schoner’ uitzagen voor de gezondheidszorg.

* Ze beweerden dat robots met een donkere huidskleur beter waren voor de bouw omdat ze ‘minder vuil vertoonden’.

Dit suggereert een fenomeen waarbij mensen logica gebruiken om onderliggende sociale vooroordelen te maskeren, waardoor het vooroordeel onzichtbaar wordt voor zowel de kiezer als de waarnemer.

De psychologie van spiegelen en competentie

De onderzoekers ontdekten ook een diepgaand verschil in de manier waarop verschillende raciale groepen omgaan met de robothuid. In een concept dat bekend staat als raciale spiegeling voelen mensen vaak een psychologische band met entiteiten die op hen lijken. Dit manifesteerde zich echter niet uniform:

“Het gebrek aan affectieve spiegeling van zwarte deelnemers zou een weerspiegeling kunnen zijn van de historische realiteit waarin de donkere huid systematisch ontdaan is van ‘warmte’ in culturele verhalen, waardoor een zwaarder beroep op ‘competentie’ wordt geforceerd.” — Hij, Zhang en Barfield

Terwijl blanke en Aziatische deelnemers robots vaak kozen op basis van hoe de kleur hen voelde (emotionele resonantie), hadden zwarte deelnemers de neiging om robots met een donkere huidskleur te kiezen op basis van hun waargenomen nut of kracht (functioneel redeneren). Dit suggereert dat de systemische sociale geschiedenis een grote invloed heeft op de manier waarop zelfs niet-menselijke entiteiten worden waargenomen.

Een verdeeld wetenschappelijk landschap

De academische gemeenschap bereikt nog lang geen consensus over de vraag of robots werkelijk een ‘ras’ bezitten. Het debat valt uiteen in drie hoofdkampen:

- De voorstanders van vooringenomenheid: Onderzoekers als Christoph Bartneck hebben paradigma’s van ‘shooter bias’ gebruikt om aan te tonen dat mensen op robots met een donkere huidskleur reageren met dezelfde vooroordelen van een fractie van een seconde die ze in digitale simulaties tegenover zwarte mensen tonen.

- De sceptici: Andere wetenschappers, zoals Jaime Banks en Kevin Koban, beweren dat mensen robots grotendeels zien als ‘niet-menselijke agenten’, en ze eerder zien als werktuigen dan als raciale wezens.

- De contextualisten: Antropologen zoals Lionel Obadia beweren dat deze bevindingen een product kunnen zijn van op de VS gerichte raamwerken en mogelijk niet van toepassing zijn op de manier waarop robots worden waargenomen in verschillende mondiale culturen.

Het ontwerpdilemma: van sciencefiction naar realiteit

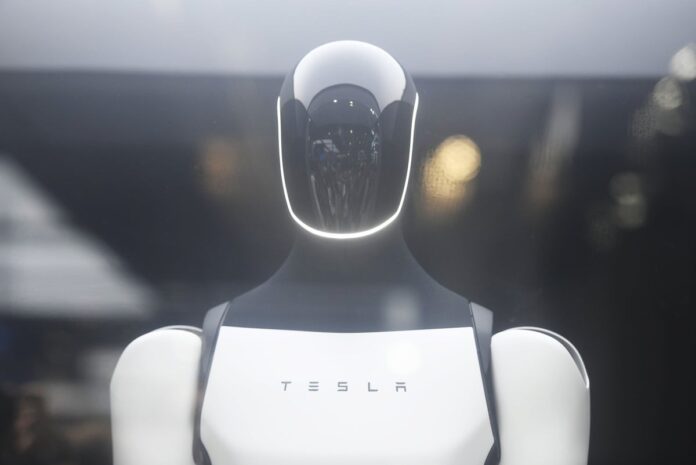

Het debat is niet langer puur academisch. Terwijl bedrijven als Tesla (Optimus) en Figure AI racen om mensachtigen in te zetten, worden de ‘esthetische’ keuzes van ingenieurs ‘socio-technische interventies’.

Filosoof Robert Sparrow merkt op dat robots twee tegenstrijdige culturele verhalen met zich meedragen:

* De Arbeider: Historisch gezien komt het woord ‘robot’ voort uit een term voor dwangarbeid, waarbij machines worden gepositioneerd als een raciale onderklasse.

* De toekomst: Een groot deel van de sciencefiction uit de 20e eeuw beeldde een ‘witte’ toekomst af, waardoor veel ingenieurs slanke, lichtgekleurde machines gingen ontwerpen die een ambitieus, verwesterd ideaal vertegenwoordigen.

Deze spanning is duidelijk zichtbaar in het ontwerp van Tesla’s Optimus, dat kritiek heeft gekregen vanwege zijn kleurenschema, waarbij sommige experts suggereren dat het ontwerp onbedoeld problematische historische beelden van dienstbaarheid kan oproepen.

Conclusie

Naarmate humanoïde robots zich integreren in de beroepsbevolking, bestaat het risico niet alleen dat ze menselijke arbeid zullen nabootsen, maar ook dat ze menselijke vooroordelen zullen erven. Als ontwerpers en gebruikers deze vooroordelen niet bewust aanpakken, kunnen we een robotpersoneel bouwen dat juist de sociale hiërarchieën versterkt die we proberen te ontmantelen.