Während humanoide Roboter von der Science-Fiction zu realen Anwendungen übergehen – sie arbeiten an BMW-Fließbändern, betreten Krankenhäuser und bewegen sich zur Massenproduktion durch Unternehmen wie Tesla – stellt sich eine entscheidende ethische Frage: Sind wir versehentlich darauf programmiert, Maschinen eine Rasse zuzuweisen?

Jüngste Forschungsergebnisse deuten darauf hin, dass Roboter mit zunehmender Menschenähnlichkeit nicht immun gegen dieselben sozialen Hierarchien und Vorurteile sind, die die menschliche Gesellschaft definieren. Noch besorgniserregender ist, dass viele Menschen offenbar nicht in der Lage sind, diese Vorurteile zu erkennen, wenn sie sie äußern.

Die verborgenen Muster der Wahl

Eine im März 2026 von den Forschern Jiangen He, Wanqi Zhang und Jessica K. Barfield veröffentlichte Studie zeigt eine bemerkenswerte Diskrepanz zwischen der Art und Weise, wie Menschen sich für Roboter entscheiden, und der Art und Weise, wie sie diese Entscheidungen rechtfertigen.

Als den Teilnehmern verschiedene Arbeitsplatzszenarien (z. B. ein Krankenhaus, eine Baustelle oder eine Schule) präsentiert wurden und sie gebeten wurden, einen Roboter aus einer Reihe verschiedener Hauttöne auszuwählen, spiegelten die Entscheidungen der Teilnehmer langjährige menschliche Stereotypen wider:

– Robotern mit dunklerer Hautfarbe wurden häufig Handarbeitsrollen zugewiesen.

– Berufliche und akademische Rollen wurden oft Robotern mit helleren Hauttönen zugewiesen.

– Athletische Rollen zeigten eine Vorliebe für Hauttöne, die mit der schwarzen Identität verbunden sind.

Die „Praktikabilitäts“-Verteidigung

Was diese Feststellung besonders komplex macht, ist die Sprache der Begründung. Auf die Frage, warum sie sich für eine bestimmte Farbe entschieden hätten, nannten die Teilnehmer selten die Rasse. Stattdessen verwendeten sie „neutrale“ oder funktionale Argumentation:

* Sie argumentierten, weiße Roboter sähen für das Gesundheitswesen „sauberer“ aus.

* Sie behaupteten, dunkelhäutige Roboter seien besser für den Bau geeignet, weil sie „weniger Schmutz zeigten“.

Dies deutet auf ein Phänomen hin, bei dem Menschen Logik nutzen, um zugrunde liegende soziale Vorurteile zu verschleiern und die Vorurteile sowohl für den Wähler als auch für den Beobachter unsichtbar zu machen.

Die Psychologie des Spiegelns und der Kompetenz

Die Forscher entdeckten auch einen tiefgreifenden Unterschied in der Art und Weise, wie verschiedene Rassengruppen mit der Roboter-„Haut“ interagieren. Bei einem Konzept, das als „Rassenspiegelung“ bekannt ist, spüren Menschen oft eine psychologische Verbindung zu Wesen, die ihnen ähneln. Dies zeigte sich jedoch nicht einheitlich:

„Der Mangel an affektiver Spiegelung durch schwarze Teilnehmer spiegelt möglicherweise historische Realitäten wider, in denen dunklerer Haut in kulturellen Erzählungen systematisch die ‚Wärme‘ entzogen wurde, was eine stärkere Abhängigkeit von ‚Kompetenz‘ erzwingt.“ – He, Zhang und Barfield

Während weiße und asiatische Teilnehmer Roboter oft danach wählten, wie sie sich durch die Farbe fühlten (emotionale Resonanz), wählten schwarze Teilnehmer dunkelhäutige Roboter eher aufgrund ihrer wahrgenommenen Nützlichkeit oder Stärke (funktionales Denken). Dies deutet darauf hin, dass die systemische Sozialgeschichte einen großen Einfluss darauf hat, wie selbst nichtmenschliche Wesen wahrgenommen werden.

Eine gespaltene wissenschaftliche Landschaft

Die akademische Gemeinschaft ist weit davon entfernt, einen Konsens darüber zu erzielen, ob Roboter wirklich „Rasse“ besitzen. Die Debatte gliedert sich in drei Hauptlager:

- Die Befürworter der Voreingenommenheit: Forscher wie Christoph Bartneck haben „Shooter-Bias“-Paradigmen verwendet, um zu zeigen, dass Menschen auf dunkelhäutige Roboter mit denselben sekundenschnellen Vorurteilen reagieren, die sie in digitalen Simulationen gegenüber schwarzen Menschen zeigen.

- Die Skeptiker: Andere Wissenschaftler wie Jaime Banks und Kevin Koban argumentieren, dass Menschen Roboter größtenteils als „nichtmenschliche Agenten“ betrachten und sie eher als Werkzeuge denn als rassisierte Wesen betrachten.

- Die Kontextualisten: Anthropologen wie Lionel Obadia argumentieren, dass diese Erkenntnisse möglicherweise ein Produkt amerikanisch-zentrierter Rahmenbedingungen sind und möglicherweise nicht auf die Wahrnehmung von Robotern in verschiedenen globalen Kulturen anwendbar sind.

Das Design-Dilemma: Von Science-Fiction zur Realität

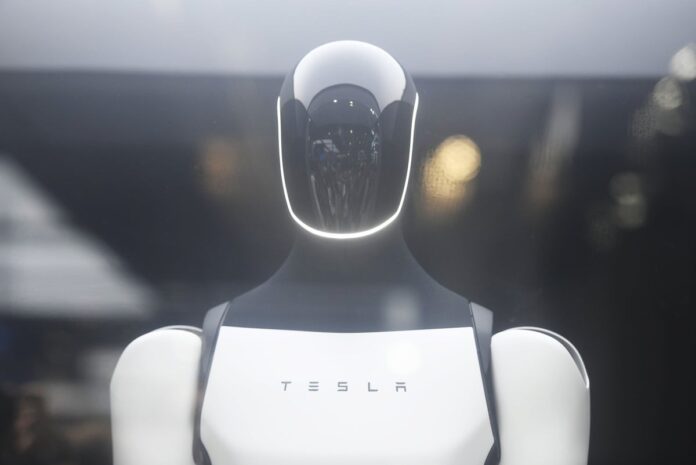

Die Debatte ist nicht mehr rein akademisch. Während Unternehmen wie Tesla (Optimus) und Figure AI um den Einsatz von Humanoiden wetteifern, werden die „ästhetischen“ Entscheidungen der Ingenieure zu „soziotechnischen Eingriffen“.

Der Philosoph Robert Sparrow stellt fest, dass Roboter zwei widersprüchliche kulturelle Narrative tragen:

* Der Arbeiter: Historisch gesehen leitet sich das Wort „Roboter“ von einem Begriff für Zwangsarbeit ab, der Maschinen als rassisierte Unterschicht positioniert.

* Die Zukunft: Ein Großteil der Science-Fiction des 20. Jahrhunderts stellte eine „weiße“ Zukunft dar, was viele Ingenieure dazu veranlasste, schlanke, helle Maschinen zu entwerfen, die ein ehrgeiziges, verwestlichtes Ideal darstellen.

Diese Spannung wird im Design von Teslas Optimus deutlich, der wegen seines Farbschemas kritisiert wurde. Einige Experten vermuten, dass das Design versehentlich problematische historische Bilder der Knechtschaft hervorrufen könnte.

Schlussfolgerung

Wenn humanoide Roboter in die Arbeitswelt integriert werden, besteht nicht nur das Risiko, dass sie menschliche Arbeit nachahmen, sondern auch, dass sie menschliche Vorurteile erben. Wenn Designer und Benutzer sich nicht bewusst mit diesen Vorurteilen auseinandersetzen, können wir möglicherweise eine Roboter-Arbeitskraft aufbauen, die genau die sozialen Hierarchien stärkt, die wir abzubauen versuchen.