По мере того как человекоподобные роботы переходят из разряда научной фантастики в сферу реального применения — работая на сборочных линиях BMW, внедряясь в больницы и готовясь к массовому производству такими компаниями, как Tesla, — возникает критически важный этический вопрос: не запрограммированы ли мы подсознательно приписывать машинам расовую принадлежность?

Последние исследования показывают, что по мере того, как роботы становятся всё более похожими на людей, они не застрахованы от тех же социальных иерархий и предубеждений, которые определяют человеческое общество. Что еще более тревожно, многие люди, кажется, не способны распознать эти предубеждения, когда совершают их сами.

Скрытые паттерны выбора

Исследование, опубликованное в марте 2026 года исследователями Цзяньгэном Хэ, Ваньци Чжан и Джессикой К. Барфилд, выявило поразительный разрыв между тем, как люди выбирают роботов, и тем, как они оправдывают свой выбор.

Когда участникам предлагались различные сценарии рабочего процесса (например, больница, стройка или школа) и просили выбрать робота из ряда моделей с разным оттенком кожи, их выбор отражал давние человеческие стереотипы:

– Роли, связанные с физическим трудом, часто отдавались роботам с более темным оттенком кожи.

– Профессиональные и академические роли зачастую закреплялись за роботами со светлым оттенком кожи.

– Спортивные роли демонстрировали предпочтение оттенков кожи, ассоциирующихся с чернокожим населением.

Защита «практичностью»

Особую сложность этим выводам придает язык оправданий. Когда участников спрашивали, почему они выбрали конкретный цвет, они редко упоминали расу. Вместо этого они использовали «нейтральные» или функциональные аргументы:

* Они утверждали, что белые роботы выглядят «чище» для сферы здравоохранения.

* Они заявляли, что темнокожие роботы лучше подходят для строительства, так как на них «меньше видна грязь».

Это указывает на феномен, при котором люди используют логику, чтобы замаскировать глубинные социальные предубеждения, делая их невидимыми как для самого выбирающего, так и для наблюдателя.

Психология зеркального отражения и компетентности

Исследователи также обнаружили глубокую разницу в том, как различные расовые группы взаимодействуют с «кожей» роботов. В рамках концепции, известной как расовое зеркальное отражение (racial mirroring ), люди часто чувствуют психологическую связь с объектами, которые похожи на них самих. Однако это проявлялось неравномерно:

«Отсутствие эмоционального зеркального отражения у чернокожих участников может отражать исторические реалии, когда темная кожа в культурных нарративах систематически лишалась “тепла”, что вынуждало делать больший упор на “компетентность”». — Хэ, Чжан и Барфилд

В то время как белые и азиатские участники часто выбирали роботов на основе того, какие чувства вызывает у них цвет (эмоциональный резонанс), чернокожие участники склонны выбирать темнокожих роботов, исходя из их предполагаемой полезности или силы (функциональное обоснование). Это говорит о том, что системная социальная история глубоко влияет на то, как воспринимаются даже нечеловеческие сущности.

Раскол в научном сообществе

Академическое сообщество еще далеко от консенсуса относительно того, обладают ли роботы «расой» на самом деле. Дискуссия разделена на три основных лагеря:

- Сторонники теории предвзятости: Исследователи, такие как Кристоф Бартнек, использовали парадигмы «ошибки стрелка», чтобы показать, что люди реагируют на темнокожих роботов с теми же мгновенными предубеждениями, которые они проявляют по отношению к чернокожим людям в цифровых симуляциях.

- Скептики: Другие ученые, такие как Джейми Бэнкс и Кевин Кобан, утверждают, что люди в основном рассматривают роботов как «нечеловеческих агентов», видя в них инструменты, а не расовых существ.

- Контекстуалисты: Антропологи, такие как Лионель Обадиа, утверждают, что эти результаты могут быть продуктом американоцентричных моделей и могут не применяться к тому, как роботы воспринимаются в различных мировых культурах.

Дилемма дизайна: от научной фантастики к реальности

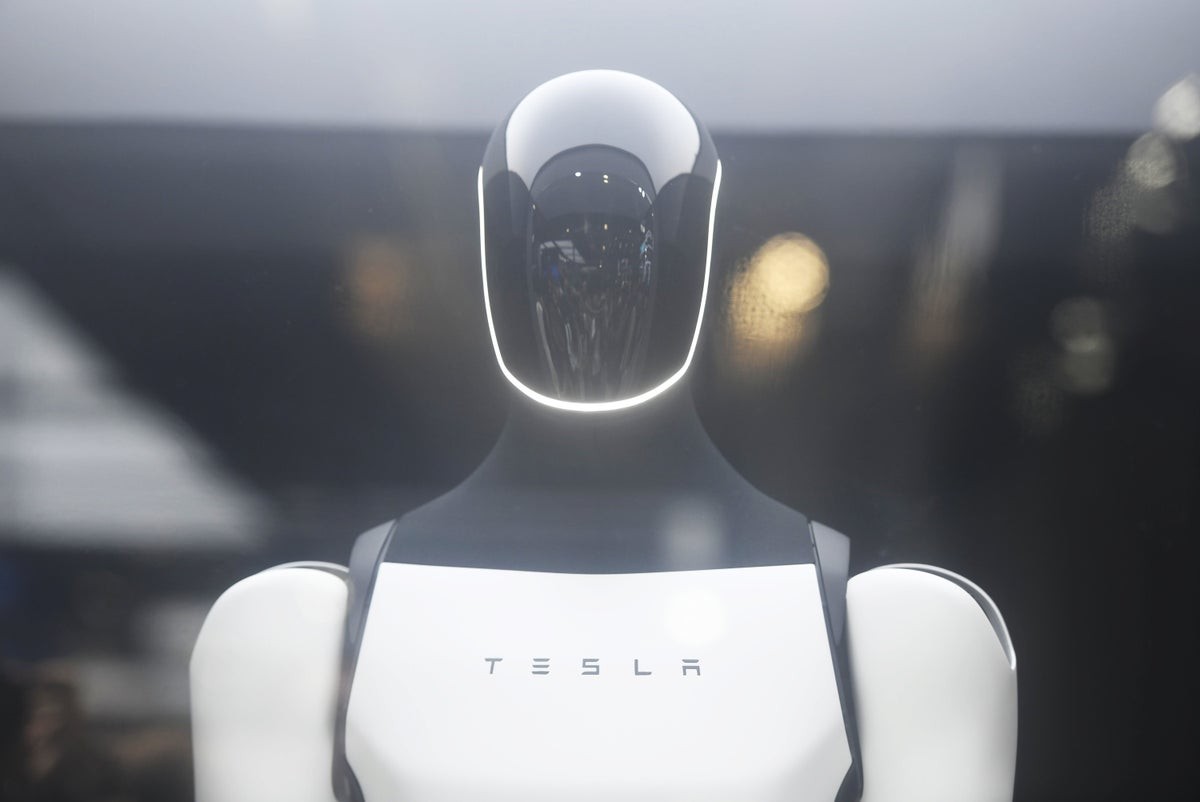

Этот спор перестал быть чисто академическим. В то время как такие компании, как Tesla (Optimus) и Figure AI, соревнуются в развертывании гуманоидов, «эстетический» выбор инженеров становится «социотехническим вмешательством».

Философ Роберт Спэрроу отмечает, что роботы несут в себе два противоречивых культурных нарратива:

* Рабочий: Исторически слово «робот» происходит от термина, означающего принудительный труд, что позиционирует машины как расовый низший класс.

* Будущее: Большая часть научной фантастики XX века изображала «белое» будущее, что побуждает многих инженеров проектировать гладкие, светлые машины, представляющие собой идеализированный западный стандарт.

Это напряжение заметно в дизайне Tesla Optimus, который столкнулся с критикой из-за цветовой схемы: некоторые эксперты предполагают, что дизайн может непреднамеренно вызывать проблемные исторические образы служения.

Заключение

По мере интеграции человекоподобных роботов в рабочую силу риск заключается не только в том, что они будут имитировать человеческий труд, но и в том, что они унаследуют человеческие предрассудки. Если дизайнеры и пользователи не будут сознательно работать с этими предубеждениями, мы можем создать роботизированную рабочую силу, которая лишь укрепит те самые социальные иерархии, которые мы пытаемся разрушить.